参考:https://www.cnblogs.com/pinard/p/6418668.html

基本结构

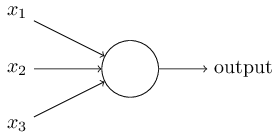

局部看

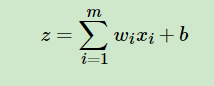

输出和输入之间学习到一个线性关系,得到中间输出结果:

接着是一个神经元激活函数:

也可以是别的激活函数:Sigmoid函数、tanx, softmax,和ReLU等

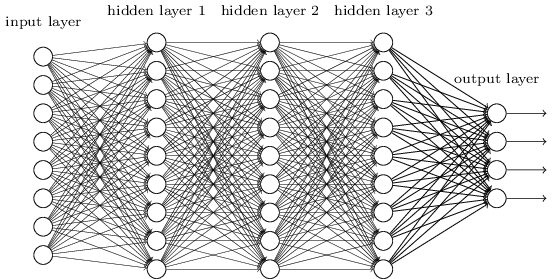

宏观看

注意:w是与两层神经元中的两个有关系,b是某个神经元的值。输入层没有w和b

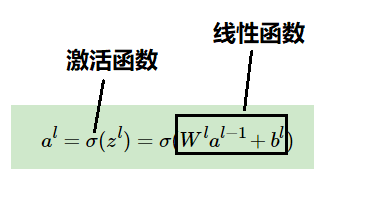

前向传播

概括来说,前向传播就是一个神经元通过对输入做线性变化、激活函数激活后变成下一层神经元的输入。最后一层一层下去到输出层。