Logistic回归损失函数

损失函数(loss)

-

损失函数又叫做误差函数,用来衡量算法的运行情况,是预测值与实际值的差距,Loss function :L(y^,y)

-

衡量的是算法在单个训练样本中表现

-

损失函数越小,说明预测输出值和实际值越接近

-

在线性回归中我们看到损失函数的式子是用预测值和实际值的平方差或者它们平方差:loss=(y^-y)2

-

在逻辑回归中我们不这么做,因为平方差会使得有多个局部最优值,在逻辑回归的损失函数是:

loss=-ylog(y^)-(1-y)log(1-y^) -

那么为什么上面式子符合呢?

- 前面几节讲过y的取值是{0,1},y^是图片是猫图的概率,一个概率值取值在(0,1)

- 所以我们需要一个损失函数满足:loss越小时,y与y^越接近

- 当 y=1时损失函数 L = − log ( y^) ,如果想要损失函数 L 尽可能得小,那么 y^ 就要尽可能大,因为sigmoid函数取值 [ 0 , 1 ] ,所以 y^ 会无限接近于1。

- 当 y=0时损失函数 L = − log (1- y^) ,如果想要损失函数 L 尽可能得小,那么 y^ 就要尽可能大,因为sigmoid函数取值 [ 0 , 1 ] ,所以 y^ 会无限接近于0

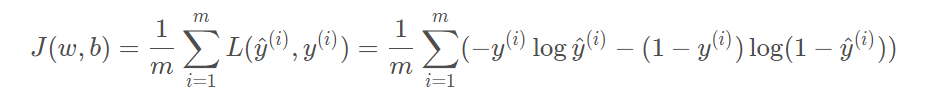

成本函数(cost)

-

衡量算法在全部训练样本上的表现

-

算法的代价函数是对 m 个样本的损失函数求和然后除以 m

-

公式: