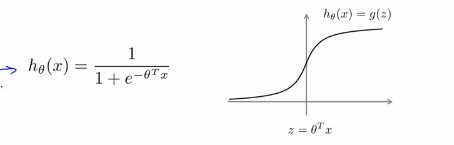

1.为了描述SVM,需要从logistic回归开始进行学习,通过改变一些小的动作来进行支持向量机操作。在logistic回归中我们熟悉了这个假设函数以及右边的sigmoid函数,下式中z表示θ的转置乘以x,

(1)如果我们有一个样本,其中y=1,这样的一个样本来自训练集或者测试集或者交叉验证集,我们希望h(x)能尽可能的接近1。因此我们想要正确的将样本进行分类,如果h(x)趋近于1,就意味着 远大于0,即

远大于0,即 。

。

(2)相应的如果y=0,我们想hθ(x)=0,那么 远远小于0,即

远远小于0,即

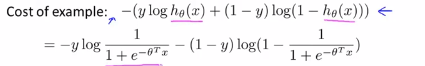

(3)logistic regresssion的代价函数:

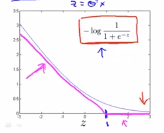

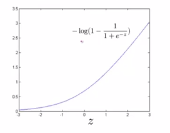

如果y=1,当 的时候,我们可以画下图:

的时候,我们可以画下图:

如果y=0,当 ,我们可以画下图:

,我们可以画下图:

线性回归代价函数:

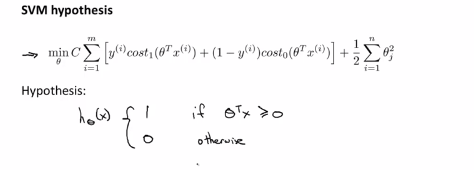

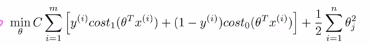

支持向量机代价函数:

与logistic回归不同的是,支持向量机并不会输出概率,而是优化上面的这个代价函数,得到一个参数θ,而支持向量机所做的是进行了一个直接的预测,预测y是0还是1.所以如果θ的转置乘以x的值大于0,那么它就会输出1;如果θ的转置乘以x的转置小于0 ,那么它就会输出0