结合之前写的一篇文章:ELK日志分析平台搭建全过程,上篇文章主要讲了部署方法。而这篇文章介绍的是单独监控nginx 日志分析再进行可视化图形展示。

本文环境与上一篇环境一样,前提 elasticsearch 已安装完成,并成功启动。

一、nginx 安装

因为只是测试,所以简单安装下就可以。

[root@server ~]# cd /usr/local/src/ [root@server ~]# wget http://nginx.org/download/nginx-1.13.5.tar.gz [root@server ~]# tar -zxf nginx-1.13.5.tar.gz [root@server ~]# cd nginx-1.13.5 [root@server nginx-1.13.5]# ./configure --prefix==/usr/local/nginx

缺什么yum 安装下就可以。

然后,make && make install 就行

nginx日志文件其中一行:

192.168.1.26 - - [14/Sep/2017:16:48:42 +0800] "GET /ui/favicons/favicon-16x16.png HTTP/1.1" 304 0

"http://192.168.1.124/app/kibana" "Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/59.0.3071.115 Safari/537.36" "-"

nginx 服务器日志的log_format格式:

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

二、配置logstash

1.修改配置文件,/opt/elk/logstash-5.2.2下。创建一个新的配置文件,内容如下:

[root@server logstash-5.2.2]# cat config.d/nginx_accss.conf input { file { path => [ "/usr/local/nginx/logs/access.log" ] start_position => "beginning" ignore_older => 0 type => "nginx-access" } } filter { if [type] == "nginx-access" { grok { match => [ "message","%{IPORHOST:clientip} %{NGUSER:ident} %{NGUSER:auth} [%{HTTPDATE:timestamp}] "%{WORD:verb} %{URIPATHPARAM:request} HTTP/%{NUMBER:httpversion}" %{NUMBER:response} (?:%{NUMBER:bytes}|-) %{QS:referrer} %{QS:agent} %{NOTSPACE:http_x_forwarded_for}" ] } urldecode { all_fields => true } date { locale => "en" match => ["timestamp" , "dd/MMM/YYYY:HH:mm:ss Z"] } geoip { source => "clientip" target => "geoip" database => "/opt/elk/logstash-5.2.2/data/GeoLite2-City.mmdb" add_field => [ "[geoip][coordinates]", "%{[geoip][longitude]}" ] add_field => [ "[geoip][coordinates]", "%{[geoip][latitude]}" ] } mutate { convert => [ "[geoip][coordinates]", "float" ] convert => [ "response","integer" ] convert => [ "bytes","integer" ] replace => { "type" => "nginx_access" } remove_field => "message" } } } output { elasticsearch { hosts => ["192.168.1.124:9200"] index => "logstash-nginx-access-%{+YYYY.MM.dd}" } stdout {codec => rubydebug} }

文件内容大致解释:

Logstash 分为 Input、Output、Filter、Codec 等多种plugins。

Input:数据的输入源也支持多种插件,如elk官网的beats、file、graphite、http、kafka、redis、exec等等等、、、

Output:数据的输出目的也支持多种插件,如本文的elasticsearch,当然这可能也是最常用的一种输出。以及exec、stdout终端、graphite、http、zabbix、nagios、redmine等等、、、

Filter:使用过滤器根据日志事件的特征,对数据事件进行处理过滤后,在输出。支持grok、date、geoip、mutate、ruby、json、kv、csv、checksum、dns、drop、xml等等、、

Codec:编码插件,改变事件数据的表示方式,它可以作为对输入或输出运行该过滤。和其它产品结合,如rubydebug、graphite、fluent、nmap等等。

具体以上插件的细节可以去官网,介绍的挺详细的。下面说下该篇中的配置文件的含义:

input段:

file:使用file 作为输入源

path: 日志的路径,支持/var/log*.log,及[ "/var/log/messages", "/var/log/*.log" ] 格式

start_position: 从文件的开始读取事件。另外还有end参数

ignore_older: 忽略早于24小时(默认值86400)的日志,设为0,即关闭该功能,以防止文件中的事件由于是早期的被logstash所忽略。

filter段:

grok:数据结构化转换工具

match:匹配条件格式,将nginx日志作为message变量,并应用grok条件NGINXACCESS进行转换

geoip:该过滤器从geoip中匹配ip字段,显示该ip的地理位置

source:ip来源字段,这里我们选择的是日志文件中的最后一个字段,如果你的是默认的nginx日志,选择第一个字段即可(注:这里写的字段是/opt/logstash/patterns/nginx 里面定义转换后的)

target:指定插入的logstash字断目标存储为geoip

database:geoip数据库的存放路径

add_field: 增加的字段,坐标经度

add_field: 增加的字段,坐标纬度

mutate: 数据的修改、删除、类型转换

convert: 将坐标转为float类型

convert: http的响应代码字段转换成 int

convert: http的传输字节转换成int

replace: 替换一个字段

remove_field: 移除message 的内容,因为数据已经过滤了一份,这里不必在用到该字段了。不然会相当于存两份

date: 时间处理,该插件很实用,主要是用你日志文件中事件的事件来对timestamp进行转换,导入老的数据必备!在这里曾让我困惑了很久哦。别再掉坑了

match:匹配到timestamp字段后,修改格式为dd/MMM/yyyy:HH:mm:ss Z

mutate:数据修改

remove_field: 移除timestamp字段。

output段:

elasticsearch:输出到es中

host: es的主机ip+端口或者es 的FQDN+端口

index: 为日志创建索引logstash-nginx-access-*,这里也就是kibana那里添加索引时的名称

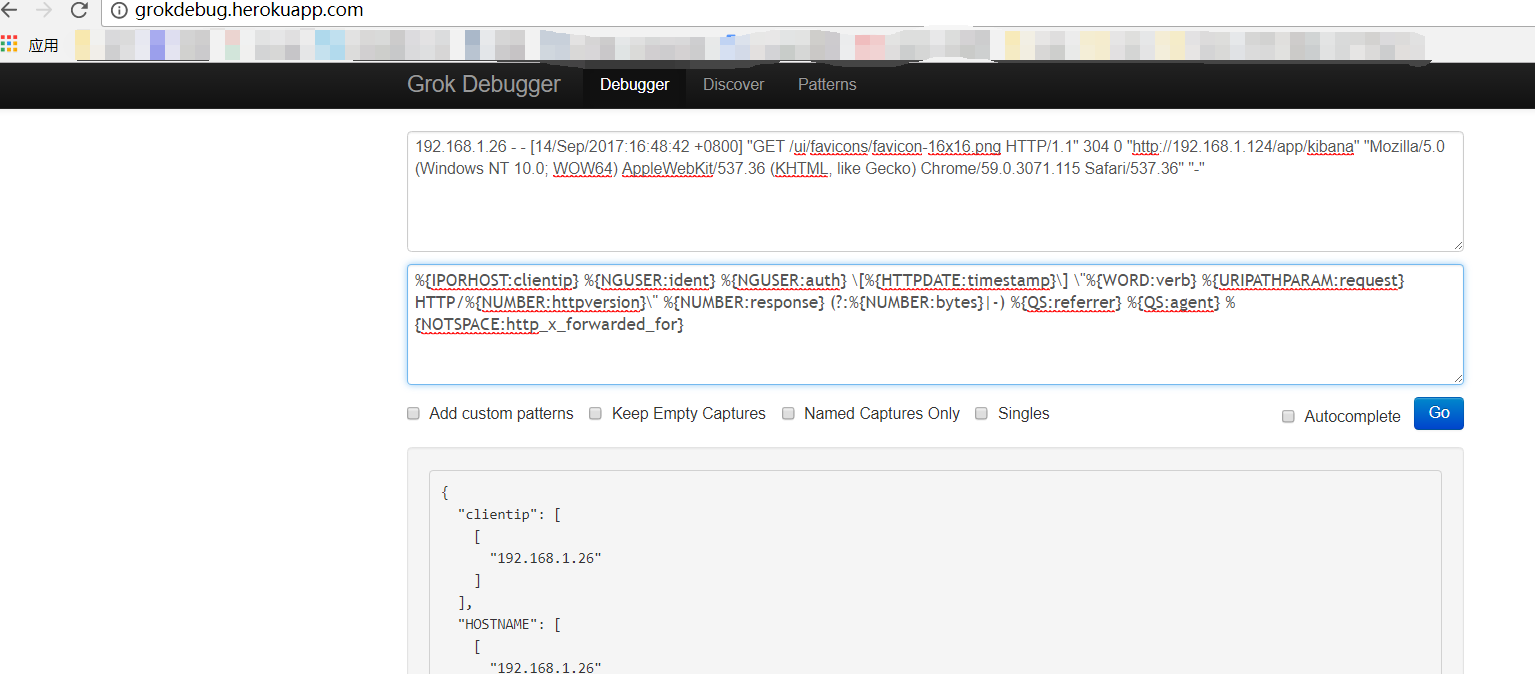

2、创建好logstash 配置文件之前,我们要先测试grok 正则匹配是否正确:

%{IPORHOST:clientip} %{NGUSER:ident} %{NGUSER:auth} [%{HTTPDATE:timestamp}] "%{WORD:verb} %{URIPATHPARAM:request} HTTP/%{NUMBER:httpversion}" %{NUMBER:response} (?:%{NUMBER:bytes}|-) %{QS:referrer} %{QS:agent} %{NOTSPACE:http_x_forwarded_for}

测试地址:http://grokdebug.herokuapp.com/

如果测试失败,修改GROK正则表达式,直到测试成功后再进行下一步操作,不然后面都是白搭。

3、然后就是logstash中配置的GeoIP的数据库解析ip了,这里是用了开源的ip数据源,用来分析客户端的ip归属地。官网在这里:MAXMIND

[root@server data]# pwd /opt/elk/logstash-5.2.2/data [root@server data]# wget http://geolite.maxmind.com/download/geoip/database/GeoLite2-City.tar.gz

解压到当前路径,并将它移动到上述我们配置的路径下,当然其它路径也是可以的,不过logstash 的配置文件也需要更改,如下:

[root@server data]# gunzip -d GeoLiteCity.dat.gz

现在我们测试下logstash 的配置文件,使用它自带的命令去测试,如下:

[root@server data]# /opt/elk/logstash-5.2.2/bin/logstash -t -f /opt/elk/logstash-5.2.2/config.d/nginx_accss.conf

Configuration OK

注:-t -f 参数顺序不能乱,格式就是定死的,-f 后面要跟配置文件;还有就是该测试只能测试语法,标点符号。如果逻辑上有错误的话,还是能启动的。这里就需要在正式启动运行时,多关注日志文件,位置:/opt/elk/logstash-5.2.2/logs/logstash-plain.log

测试成功后启动logstash

[root@server logstash-5.2.2]# nohup /opt/elk/logstash-5.2.2/bin/logstash -f /opt/elk/logstash-5.2.2/config.d/nginx_accss.conf &

tail -f nohup

出现以上内容证明 logstash 已经启动,并向elasticsearch 发送数据。

现在我们回到上一篇 ELK日志分析平台搭建全过程 接着 启动 kinaba

参考资料:

https://www.elastic.co/guide/index.html

http://grokdebug.herokuapp.com/patterns

http://www.cnblogs.com/liuning8023/p/5502460.html

https://segmentfault.com/a/1190000000489528