Hadoop是什么

1、是一个由apache基金会所开发的分布式系统基础架构

2、主要解决海量数据的存储和海量数据的分析计算

3、广义上说,Hadoop通常是一个广泛的概念------->Hadoop生态圈

发展历史

1、Lucene科=框架是Doug Cutting开创的开源软件,用java代码实现,于google类似的全文搜索功能

它提供了全文检索引擎架构,包括完整的查询引擎和索引引擎

2、2001年年底Lucene成为Apache基金会的一个子项目

3、对于海量数据的场景,Lucene面对和Google同样的问题,存数据满检索数据速度慢

4、悬系模仿Google解决方法:微型版Nutch

5、Goog是Hadoop的思想之源

论文:GFS--->HDFS, Map-Reduce--->MR,BigTable--->HBase

6、03-04年,Google公开了部分GFS和MapReduce思想的细节,以此为基础的Dong Cutting等人用了两年

业余时间实现了DFS和MapReduce机制,是哦那个Nutch性能飘升

7、05年Hadoop作为Lucene的一部分正式引入Apache基金会

8、06年,Map-Reduce和Nutch Distribute File System(NDFS)分别纳入hadoop的项目中

9、名字来源于其儿子的玩具大象

三大发行版本

Hadoop三大发行版本:Apache、Cloudrea、Hortonworks

Apache:

https://hadoop.apache.org/

Cloudera(CDH版):在大型互联网公司使用较多

https://www.cloudera.com/products/open-source/apache-hadoop/key-cdh-components.html

所有版本都是一些列的(如1.2.1直接干一套)

Hortonworks:文档比较好

Hadoop的优势

1、高可靠性

hadoop底层维护多个数据副本(至少备份三份),所以即使Hadoop某个计算元素出现故障,也不会导致数据丢失

2、高扩展性

在集群间分配任务数据,可方便地扩展数以千计地节点

3、高效性

在MapReduce的思想下,Hadoop是并行工作的,以加快任务处理速度

4、高容错性

能够自动将失败的任务重新分配

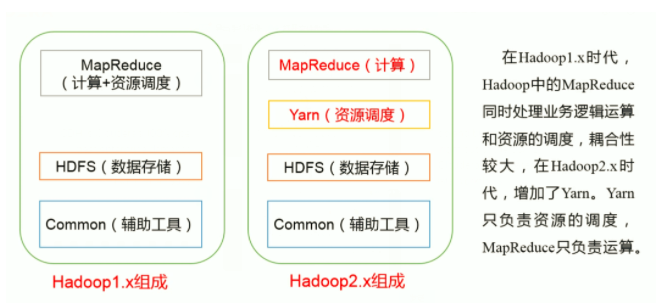

Hadoop1.x和2.x的区别

HDFS

Hadoop分布式文件系统(HDFS)被设计成适合运行在通用硬件(commodity hardware)上的分布式文件系统。

它和现有的分布式文件系统有很多共同点。但同时,它和其他的分布式文件系统的区别也是很明显的。

HDFS是一个高度容错性的系统,适合部署在廉价的机器上。

HDFS能提供高吞吐量的数据访问,非常适合大规模数据集上的应用。

HDFS放宽了一部分POSIX约束,来实现流式读取文件系统数据的目的。

HDFS在最开始是作为Apache Nutch搜索引擎项目的基础架构而开发的。

HDFS是Apache Hadoop Core项目的一部分。

这个项目的地址是http://hadoop.apache.org/core/。

1、NameNode(nn):存储文件的元素据,如文件名,文件目录结构、文件属性(生成属性,副本数,文件限制) 以及每个文件的块列表和块所在的DataNode等

2、DataNode(dn):在本地文件存储系统文件块数据,以及块数据的校验和

3、Secondary nameNode(2nn):用来监控HDFS状态的辅助后台程序,每个一段时间获取HDFS元素的快照

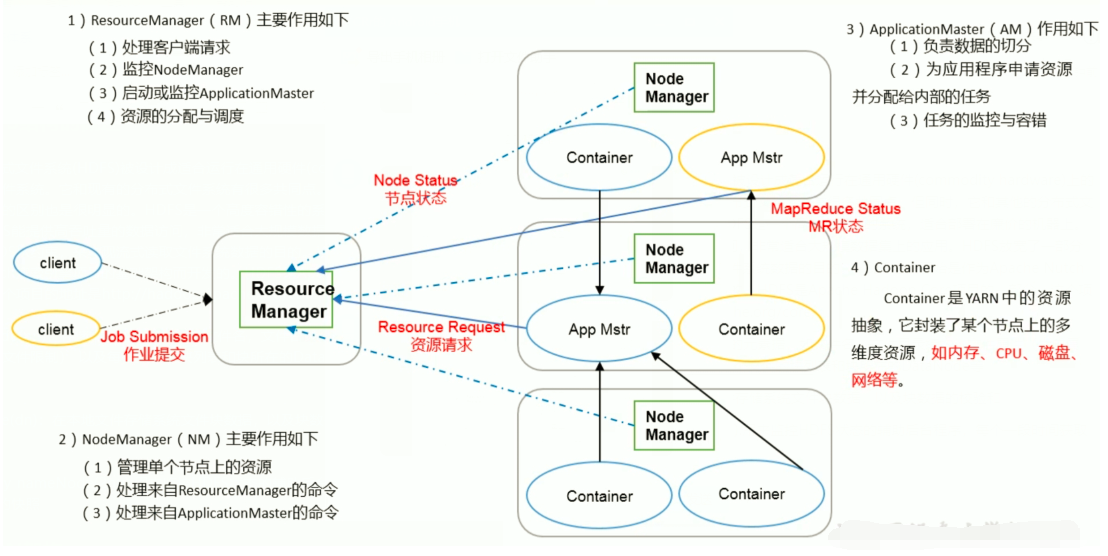

YARN

MapReduce

将计算过程分为两个阶段:Map和Reduce

Map阶段并行处理输入数据

Reduce阶段对Map结果进行汇总

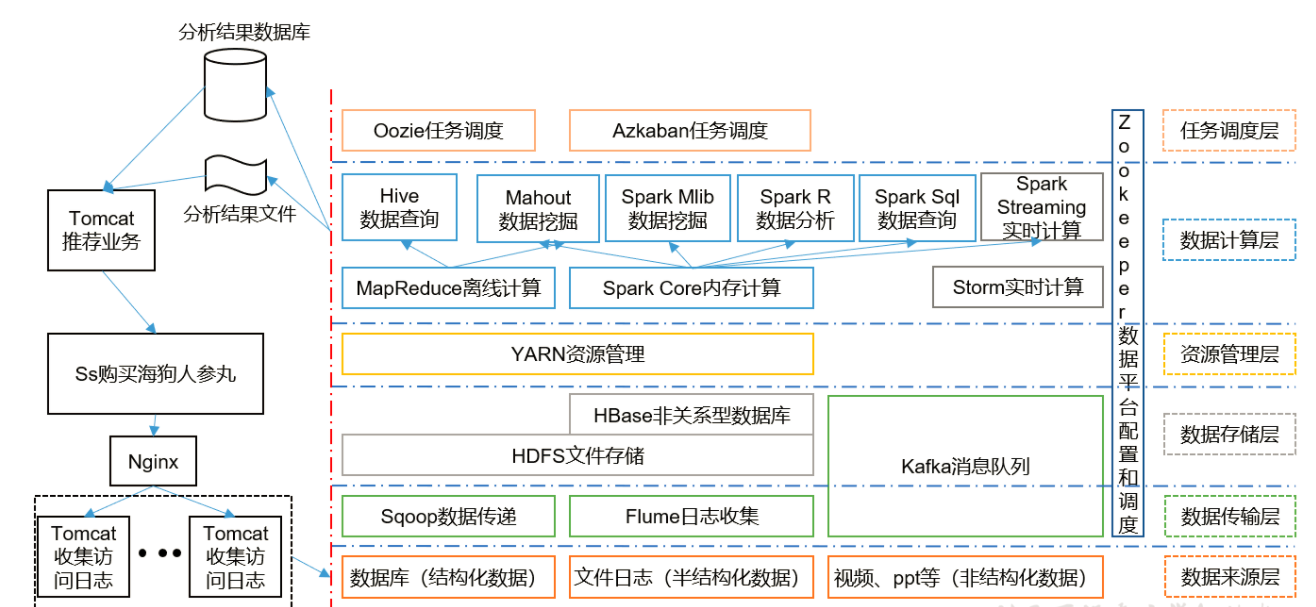

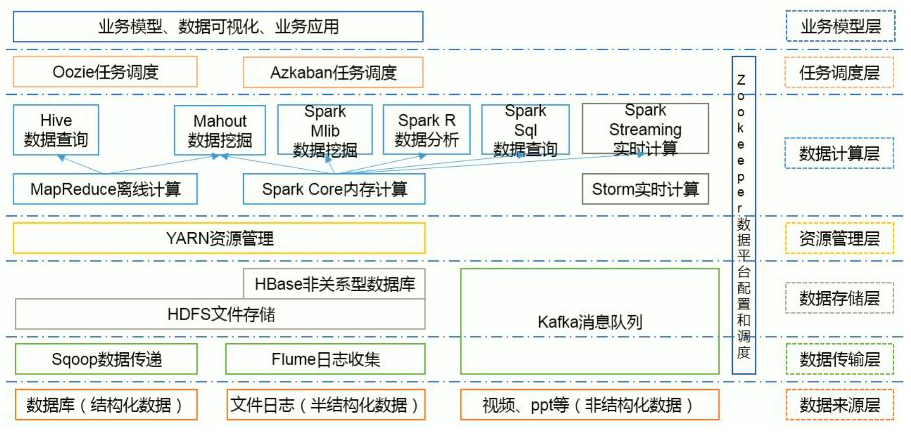

生态体系

1)Sqoop:Sqoop是一款开源的工具,主要用于在Hadoop、Hive与传统的数据库(MySql)间进行数据的传递,

可以将一个关系型数据库(例如 :MySQL,Oracle 等)中的数据导进到Hadoop的HDFS中,也可以将HDFS的数据导进到关系型数据库中。

2)Flume:Flume是Cloudera提供的一个高可用的,高可靠的,分布式的海量日志采集、聚合和传输的系统,

Flume支持在日志系统中定制各类数据发送方,用于收集数据;同时,Flume提供对数据进行简单处理,并写到各种数据接受方(可定制)的能力。

3)Kafka:Kafka是一种高吞吐量的分布式发布订阅消息系统,有如下特性:

(1)通过O(1)的磁盘数据结构提供消息的持久化,这种结构对于即使数以TB的消息存储也能够保持长时间的稳定性能。

(2)高吞吐量:即使是非常普通的硬件Kafka也可以支持每秒数百万的消息。

(3)支持通过Kafka服务器和消费机集群来分区消息。

(4)支持Hadoop并行数据加载。

4)Storm:Storm用于“连续计算”,对数据流做连续查询,在计算时就将结果以流的形式输出给用户。

5)Spark:Spark是当前最流行的开源大数据内存计算框架。可以基于Hadoop上存储的大数据进行计算。

6)Oozie:Oozie是一个管理Hdoop作业(job)的工作流程调度管理系统。

7)Hbase:HBase是一个分布式的、面向列的开源数据库。HBase不同于一般的关系数据库,它是一个适合于非结构化数据存储的数据库。

8)Hive:Hive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张数据库表,并提供简单的SQL查询功能,

可以将SQL语句转换为MapReduce任务进行运行。 其优点是学习成本低,可以通过类SQL语句快速实现简单的MapReduce统计,

不必开发专门的MapReduce应用,十分适合数据仓库的统计分析。

10)R语言:R是用于统计分析、绘图的语言和操作环境。

R是属于GNU系统的一个自由、免费、源代码开放的软件,它是一个用于统计计算和统计制图的优秀工具。

11)Mahout:Apache Mahout是个可扩展的机器学习和数据挖掘库。

12)ZooKeeper:Zookeeper是Google的Chubby一个开源的实现。它是一个针对大型分布式系统的可靠协调系统,

提供的功能包括:配置维护、名字服务、 分布式同步、组服务等。

ZooKeeper的目标就是封装好复杂易出错的关键服务,将简单易用的接口和性能高效、功能稳定的系统提供给用户。

推荐搭建系统