一、前述

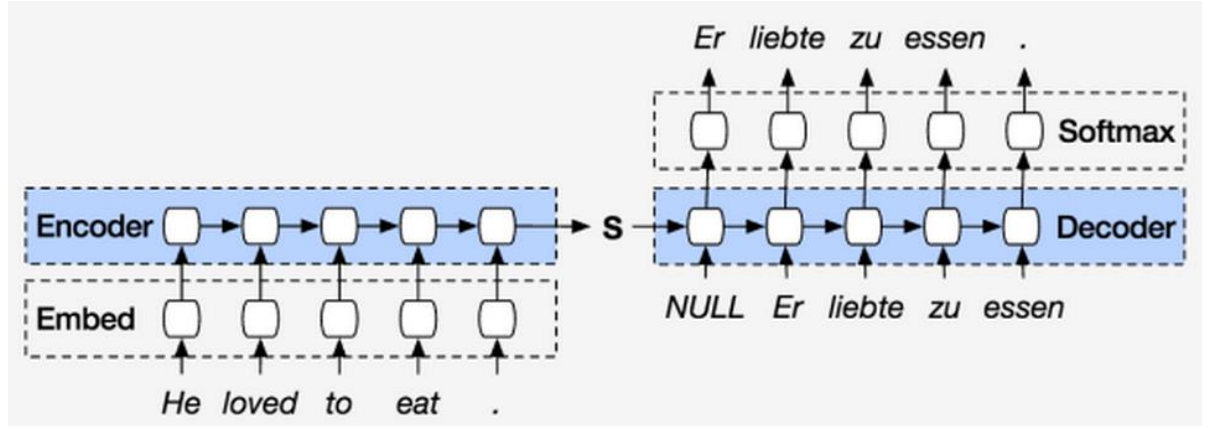

架构:

问题:

1、压缩会损失信息

2、长度会影响准确率

解决办法:

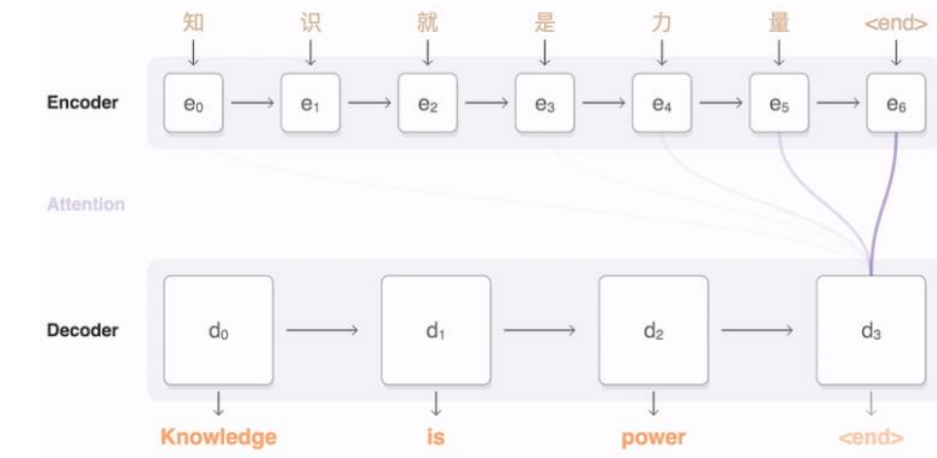

Attention机制:聚焦模式

“高分辨率”聚焦在图片的某个特定区域并以“低分辨率”,感知图像的周边区域的模式。通过大量实验证明,将attention机制应用在机器翻译,摘要生成,阅读理解等问题上,取得的成效显著。

比如翻译:“”知识”只是聚焦前两个字。

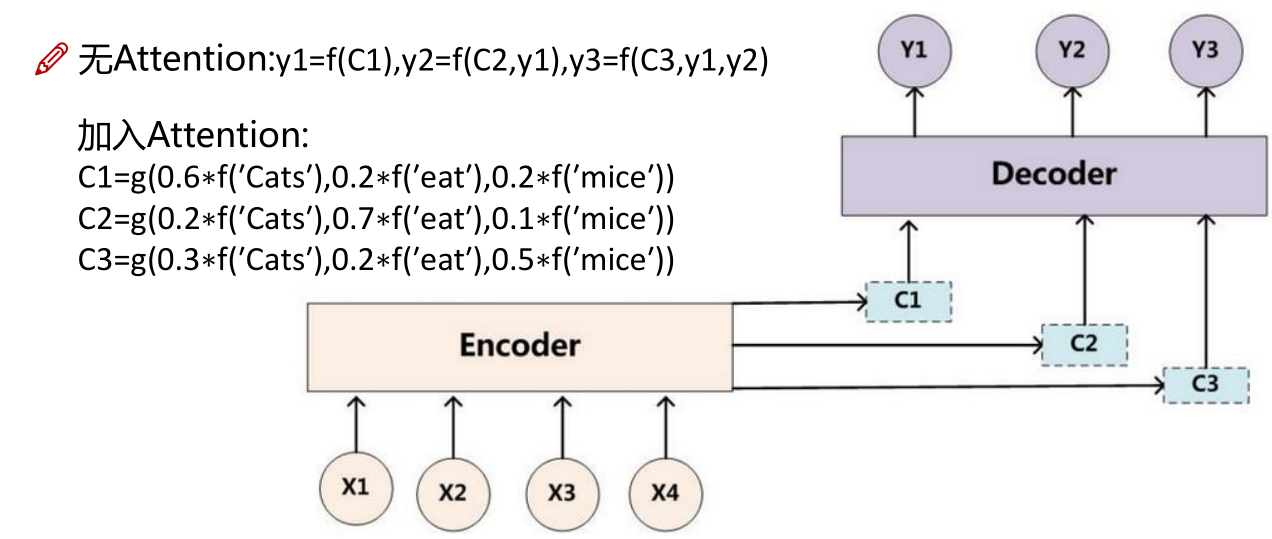

每个C取不同的概率和值:

Bucket机制:

正常情况要对所有句子进行补全,Bucket可以先分组,再计算。比如第一组计算输入[0-10],输出[0-10]。