一。概念解析:

有监督学习:对于x1,x2,x3明确知道其对应的label值

无监督学习:对于x1,x2,x3不知道其对应的label值

分类算法:对于x1,x2,x3,x4作为特征值,当输入到算法中得出有限个结果。比如对于银行借钱,输入年龄,性别,信誉等值 银行反馈借款或者不借款为分类指标。

回归算法:对于x1,x2,x3,x4作为特征值,当输入到算法中得出一个区间范围。举例:比如对于银行借钱,输入年龄,性别,信誉等值对于借钱的范围为1万~10万。

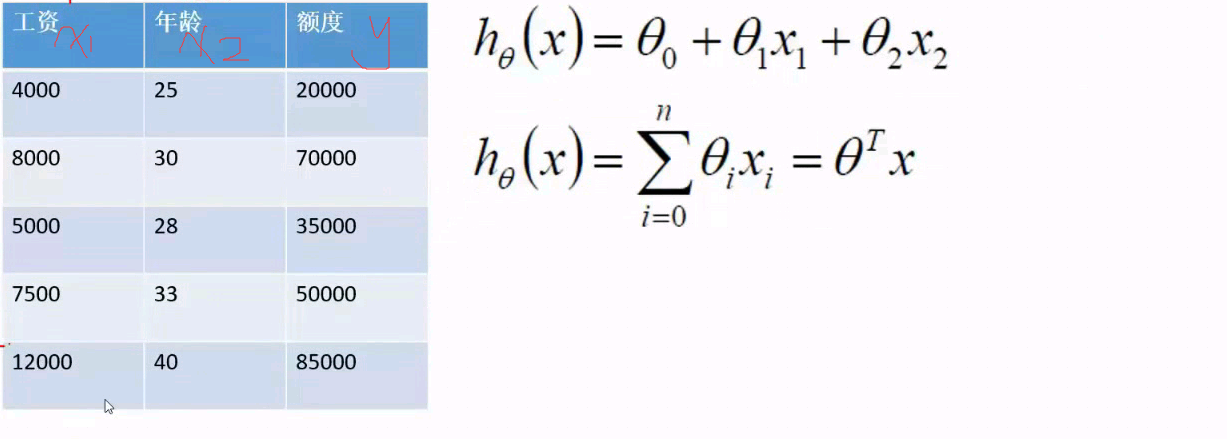

举例:

PS:y的值与x1,x2相关,第二个函数当X0=1时即可等价于上式。θTx代表转置,行向量*列向量。

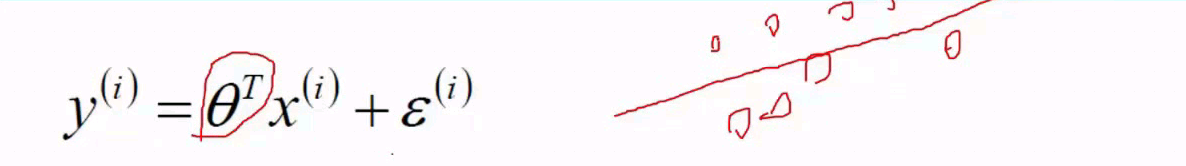

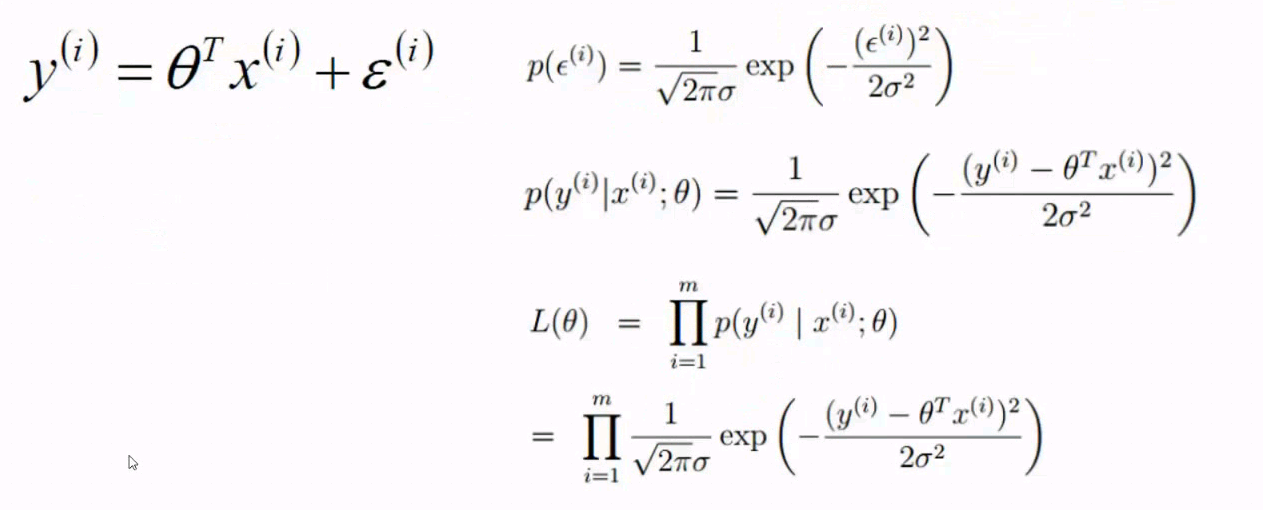

PS:每个数据点y((i)针对于模拟方程的误差ε(i),假设两个条件:

1.所有误差(每个样本点)服从高斯分布(有一定规律,没有规律也不能模拟)

2.高斯分布(u,θ2)中u(均值)为0,方差为θ2的高斯分布,其中均值为0 是因为y=θ0+θ1x+θ2x中一定能找到所有误差相加截距为0的线。

相关数学知识点:最大似然估计,高斯分布,最小二乘法。持续更新。

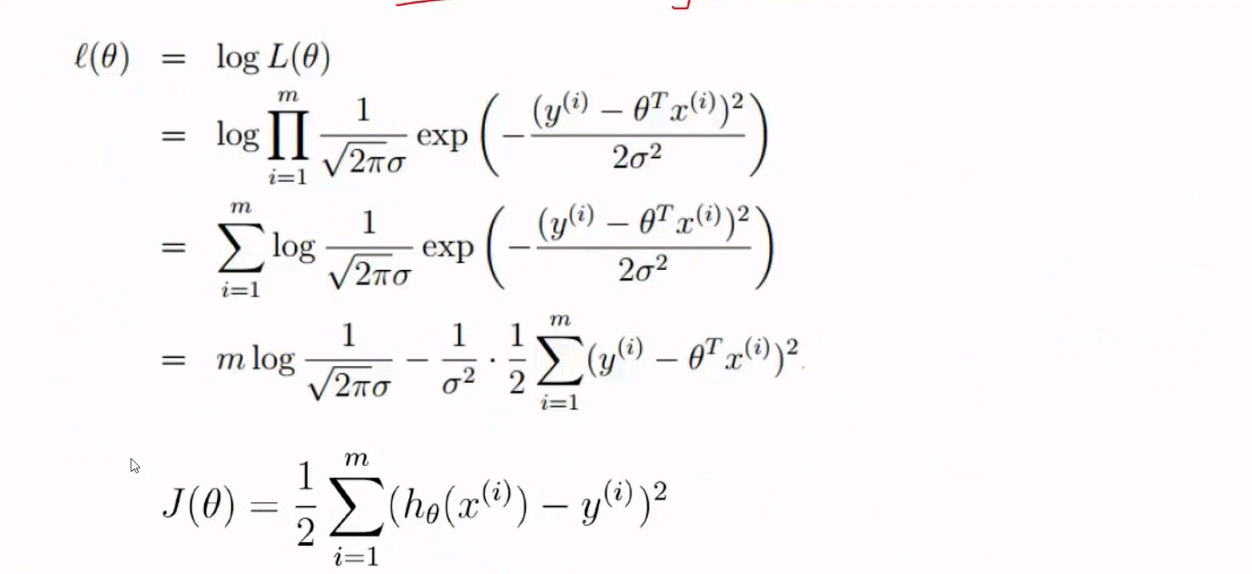

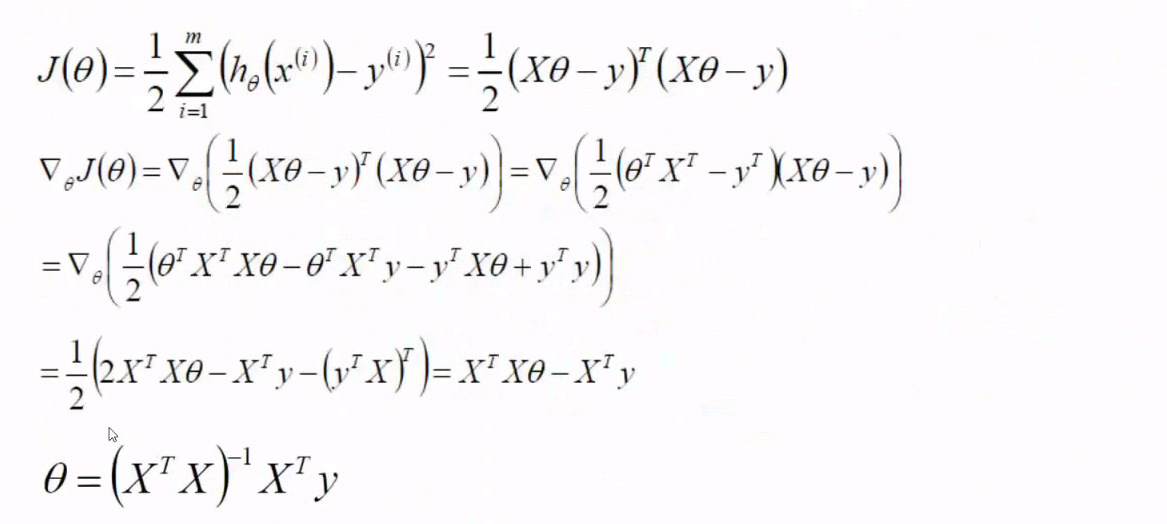

推导过程如下:详细推倒博客会进行更新 请持续关注。

PS:公式一大推结果θ值可以求得

持续更新中。。。欢迎大家关注我的公总号LHWorld