1.将kafka上传至3台服务器

kafka下载路径:http://kafka.apache.org/downloads

解压到对应的目录:tar -zxvf kafka_2.11-0.10.1.0.tgz -C /opt/software/

2.配置环境变量

添加环境变量

export KAFKA_HOME=/opt/kafka_2.11-0.10.1.0 export PATH=$PATH:$KAFKA_HOME/bin

让我们的配置文件生效:source /etc/profile

3.修改配置文件server.properties

(1)配置文件的路径:/opt/software/kafka_2.11-0.10.1.0/config/server.properties

# (1).配置 broker 的ID 21 broker.id=1 # 第一个kafka配置为 1,第二个配置为2,以此类推 # (2).打开监听端口 # 尽量写ip地址,以免造成错误 34 listeners=PLAINTEXT://192.168.0.10:9092 # (3).修改 log 的目录、在指定的位置创建好文件夹logs 60 log.dirs=/opt/software/kafka_2.11-0.10.1.0/logs # (4).修改 zookeeper.connect,尽量写ip地址,以免造成错误 116 zookeeper.connect=192.168.0.10:2181,192.168.0.11:2181,192.168.0.12:2181 # (5).网络线程数量 42 num.network.threads=3 # (6).Zookeeper每6秒监视kafka是否还活着(默认) 119 zookeeper.connection.timeout.ms=6000

(2)将修改好的配置文件分发到各个子节点上

scp -rp /opt/software/kafka_2.11-0.10.1.0/ root@hdp02:/opt/software/

scp -rp /opt/software/kafka_2.11-0.10.1.0/ root@hdp03:/opt/software/

(3)修改各个节点上的broker.id的值,以及监听端口需要修改listeners

4.启动kafka

启动kafka之前需要先启动zookeeper,然后再启动kafka,各个节点需要单独启动

(1)启动zookeeper:zkServer.sh start

(2)启动kafka:kafka-server-start.sh $KAFKA_HOME/config/server.properties & 打印日志启动

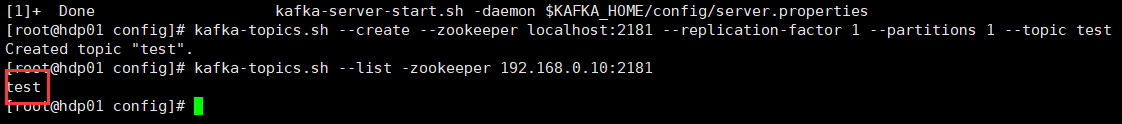

kafka-server-start.sh -daemon $KAFKA_HOME/config/server.properties & 不打印日志启动

(3)通过jps查看是否启动

5.测试

(1)通过创建一个topic(名字为test)来测试是否能成功运行,随便选择一个节点运行

kafka-topics.sh --create --zookeeper localhost:2181 --replication-factor 1 --partitions 1 --topic test

(2)列出kafka:kafka-topics.sh --list -zookeeper 192.168.195.132:2181。有刚刚的测试topic名,表示创建成功。

kafka-topics.sh --list -zookeeper 192.168.0.10:2181