服务发现Service

Service的概念

运行在Pod中的应用是向客户端提供服务的守护进程,比如,nginx、tomcat、etcd等等,它们都是受控于控制器的资源对象,存在生命周期,我们知道Pod资源对象在自愿或非自愿终端后,只能被重构的Pod对象所替代,属于不可再生类组件。而在动态和弹性的管理模式下,Service为该类Pod对象提供了一个固定、统一的访问接口和负载均衡能力。

其实,就是说Pod存在生命周期,有销毁,有重建,无法提供一个固定的访问接口给客户端。并且为了同类的Pod都能够实现工作负载的价值,由此Service资源出现了,可以为一类Pod资源对象提供一个固定的访问接口和负载均衡,类似于阿里云的负载均衡或者是LVS的功能。

即两个核心功能

- 服务发现(防止pod失联)

- 负载均衡(定义一组pod的访问策略)

但是要知道的是,Service和Pod对象的IP地址,一个是虚拟地址,一个是Pod IP地址,都仅仅在集群内部可以进行访问,无法接入集群外部流量。而为了解决该类问题的办法可以是在单一的节点上做端口暴露(hostPort)以及让Pod资源共享工作节点的网络名称空间(hostNetwork)以外,还可以使用NodePort或者是LoadBalancer类型的Service资源,或者是有7层负载均衡能力的Ingress资源。

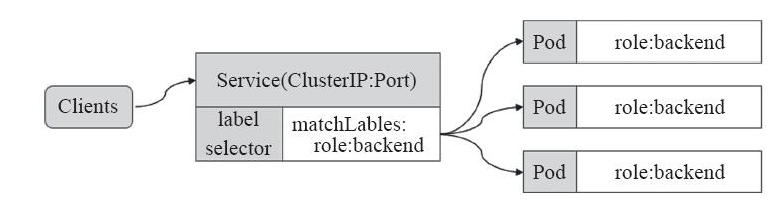

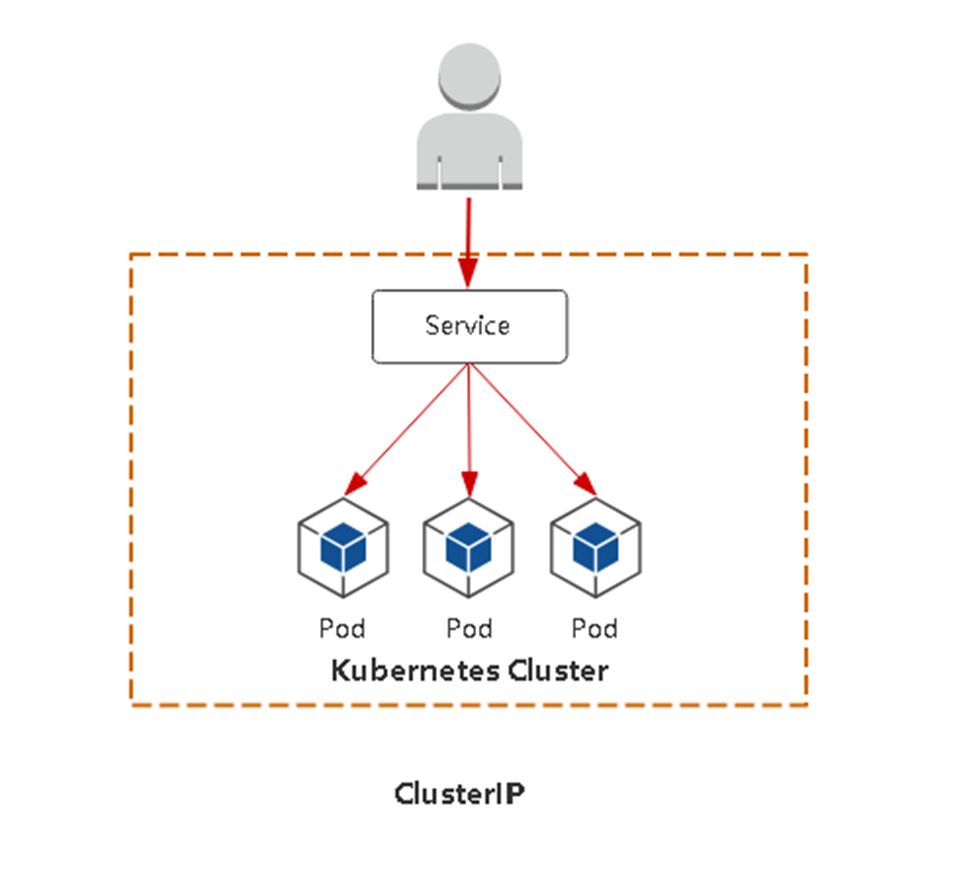

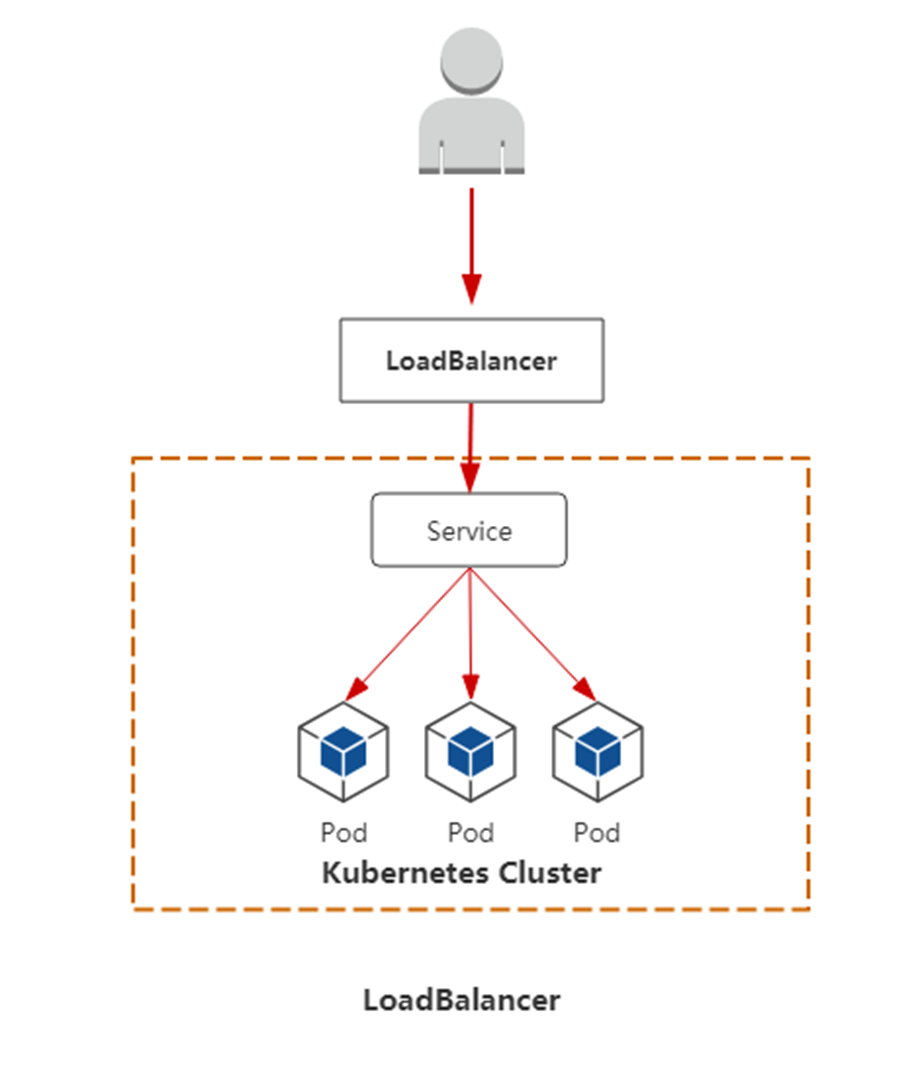

Service是Kubernetes的核心资源类型之一,Service资源基于标签选择器将一组Pod定义成一个逻辑组合,并通过自己的IP地址和端口调度代理请求到组内的Pod对象,如下图所示,它向客户端隐藏了真是的,处理用户请求的Pod资源,使得从客户端上看,就像是由Service直接处理并响应一样,是不是很像负载均衡器呢!

Service对象的IP地址也称为Cluster IP,它位于为Kubernetes集群配置指定专用的IP地址范围之内,是一种虚拟的IP地址,它在Service对象创建之后保持不变,并且能够被同一集群中的Pod资源所访问。Service端口用于接受客户端请求,并将请求转发至后端的Pod应用的相应端口,这样的代理机制,也称为端口代理,它是基于TCP/IP 协议栈的传输层。

Service的实现模型

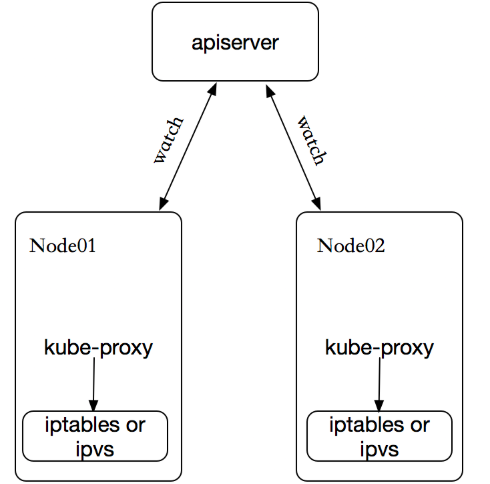

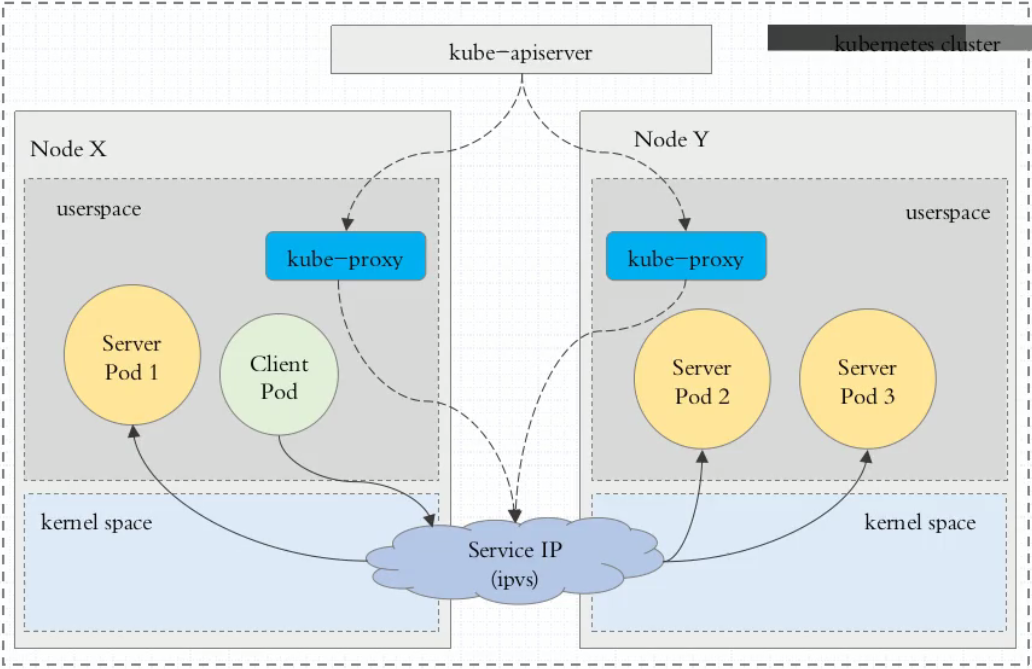

在 Kubernetes 集群中,每个 Node 运行一个 kube-proxy 进程。kube-proxy 负责为 Service 实现了一种 VIP(虚拟 IP)的形式,而不是 ExternalName 的形式。 在 Kubernetes v1.0 版本,代理完全在 userspace。在 Kubernetes v1.1 版本,新增了 iptables 代理,但并不是默认的运行模式。 从 Kubernetes v1.2 起,默认就是 iptables 代理。在Kubernetes v1.8.0-beta.0中,添加了ipvs代理。在 Kubernetes v1.0 版本,Service 是 “4层”(TCP/UDP over IP)概念。 在 Kubernetes v1.1 版本,新增了 Ingress API(beta 版),用来表示 “7层”(HTTP)服务。

kube-proxy 这个组件始终监视着apiserver中有关service的变动信息,获取任何一个与service资源相关的变动状态,通过watch监视,一旦有service资源相关的变动和创建,kube-proxy都要转换为当前节点上的能够实现资源调度规则(例如:iptables、ipvs)

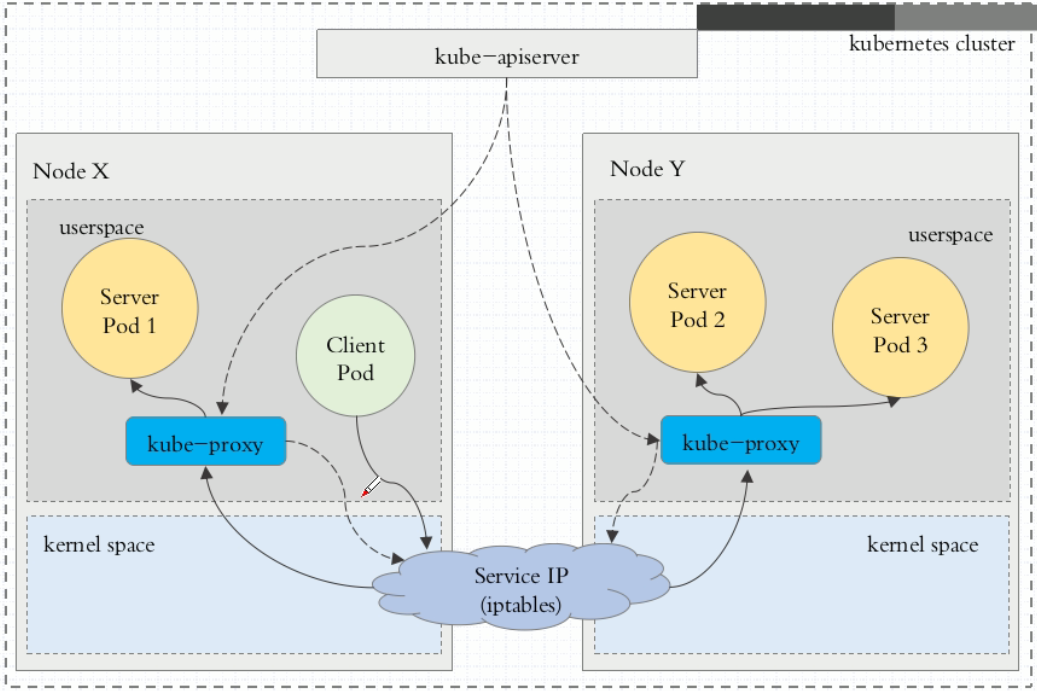

userspace代理模式

这种模式,当客户端Pod请求内核空间的service iptables后,把请求转到给用户空间监听的kube-proxy 的端口,由kube-proxy来处理后,再由kube-proxy将请求转给内核空间的 service ip,再由service iptalbes根据请求转给各节点中的的service pod。

由此可见这个模式有很大的问题,由客户端请求先进入内核空间的,又进去用户空间访问kube-proxy,由kube-proxy封装完成后再进去内核空间的iptables,再根据iptables的规则分发给各节点的用户空间的pod。这样流量从用户空间进出内核带来的性能损耗是不可接受的。在Kubernetes 1.1版本之前,userspace是默认的代理模型。

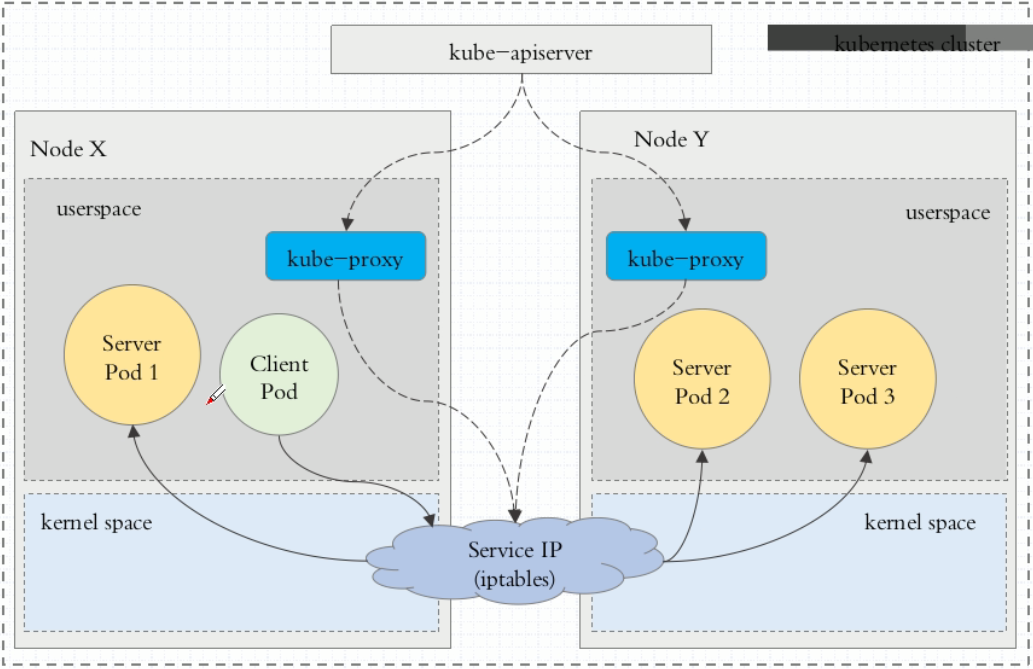

iptables代理模式

客户端IP请求时,直接请求本地内核service ip,根据iptables的规则直接将请求转发到到各pod上,因为使用iptable NAT来完成转发,也存在不可忽视的性能损耗。另外,如果集群中存在上万的Service/Endpoint,那么Node上的iptables rules将会非常庞大,性能还会再打折扣。iptables代理模式由Kubernetes 1.1版本引入,自1.2版本开始成为默认类型。

查看创建iptables规则

~]# iptables-save

ipvs代理模式

Kubernetes自1.9-alpha版本引入了ipvs代理模式,自1.11版本开始成为默认设置。客户端IP请求时到达内核空间时,根据ipvs的规则直接分发到各pod上。kube-proxy会监视Kubernetes Service对象和Endpoints,调用netlink接口以相应地创建ipvs规则并定期与Kubernetes Service对象和Endpoints对象同步ipvs规则,以确保ipvs状态与期望一致。访问服务时,流量将被重定向到其中一个后端Pod。

与iptables类似,ipvs基于netfilter 的 hook 功能,但使用哈希表作为底层数据结构并在内核空间中工作。这意味着ipvs可以更快地重定向流量,并且在同步代理规则时具有更好的性能。此外,ipvs为负载均衡算法提供了更多选项,例如:

rr:轮询调度lc:最小连接数dh:目标哈希sh:源哈希sed:最短期望延迟nq:不排队调度

注意: ipvs模式假定在运行kube-proxy之前在节点上都已经安装了IPVS内核模块。当kube-proxy以ipvs代理模式启动时,kube-proxy将验证节点上是否安装了IPVS模块,如果未安装,则kube-proxy将回退到iptables代理模式。

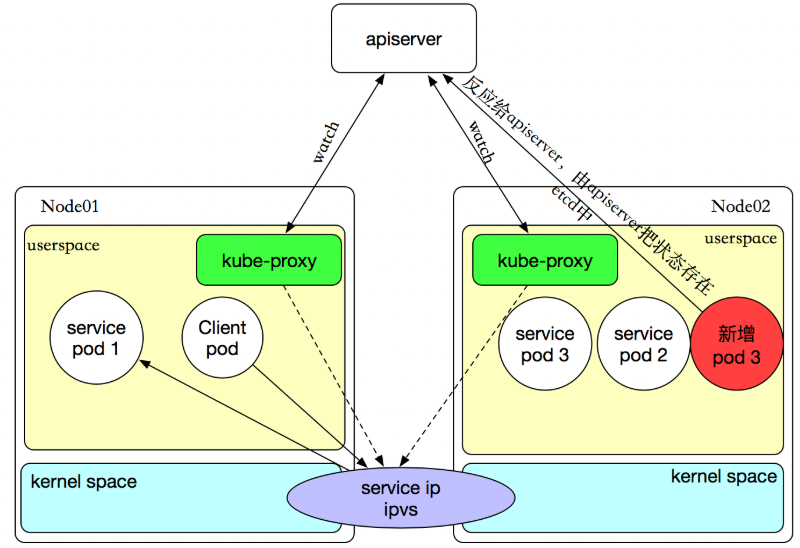

如果某个服务后端pod发生变化,标签选择器适应的pod有多一个,适应的信息会立即反映到apiserver上,而kube-proxy一定可以watch到etc中的信息变化,而将它立即转为ipvs或者iptables中的规则,这一切都是动态和实时的,删除一个pod也是同样的原理。如图:

使用IPvS模式

#加载ipvs模块:

lsmod|grep ip_vs

modprobe -- ip_vs

modprobe -- ip_vs_rr

modprobe -- ip_vs_wrr

modprobe -- ip_vs_sh

modprobe -- nf_conntrack_ipv4

#修改为ipvs模式(kubeadm安装)

kubectl edit configmap kube-proxy -n kube-system

mode: "ipvs"

#重建kube-proxy生效配置:

kubectl delete pod kube-proxy-xxx -n kube-system

#工具查看规则:

yum install ipvsadm -y

ipvsadm -L -n

Service的定义

Service资源清单解析

~]# kubectl explain svc

KIND: Service

VERSION: v1

DESCRIPTION:

Service is a named abstraction of software service (for example, mysql)

consisting of local port (for example 3306) that the proxy listens on, and

the selector that determines which pods will answer requests sent through

the proxy.

FIELDS:

apiVersion <string>

APIVersion defines the versioned schema of this representation of an

object. Servers should convert recognized schemas to the latest internal

value, and may reject unrecognized values. More info:

https://git.k8s.io/community/contributors/devel/sig-architecture/api-conventions.md#resources

kind <string>

Kind is a string value representing the REST resource this object

represents. Servers may infer this from the endpoint the client submits

requests to. Cannot be updated. In CamelCase. More info:

https://git.k8s.io/community/contributors/devel/sig-architecture/api-conventions.md#types-kinds

metadata <Object>

Standard object's metadata. More info:

https://git.k8s.io/community/contributors/devel/sig-architecture/api-conventions.md#metadata

spec <Object>

Spec defines the behavior of a service.

https://git.k8s.io/community/contributors/devel/sig-architecture/api-conventions.md#spec-and-status

status <Object>

Most recently observed status of the service. Populated by the system.

Read-only. More info:

https://git.k8s.io/community/contributors/devel/sig-architecture/api-conventions.md#spec-and-status

其中重要的4个字段:

apiVersion:

kind:

metadata:

sepc:

spec.clusterIP: 可以自定义,也可以动态分配

spec.ports:(与后端容器端口关联)

spec.selector:(关联到哪些pod资源上)

spec.type:服务类型

Service的类型

对一些应用(如 Frontend)的某些部分,可能希望通过外部(Kubernetes 集群外部)IP 地址暴露 Service。

Kubernetes ServiceTypes 允许指定一个需要的类型的 Service,默认是 ClusterIP 类型。

Type 的取值以及行为如下:

ClusterIP:通过集群的内部 IP 暴露服务,选择该值,服务只能够在集群内部可以访问,这也是默认的ServiceType。

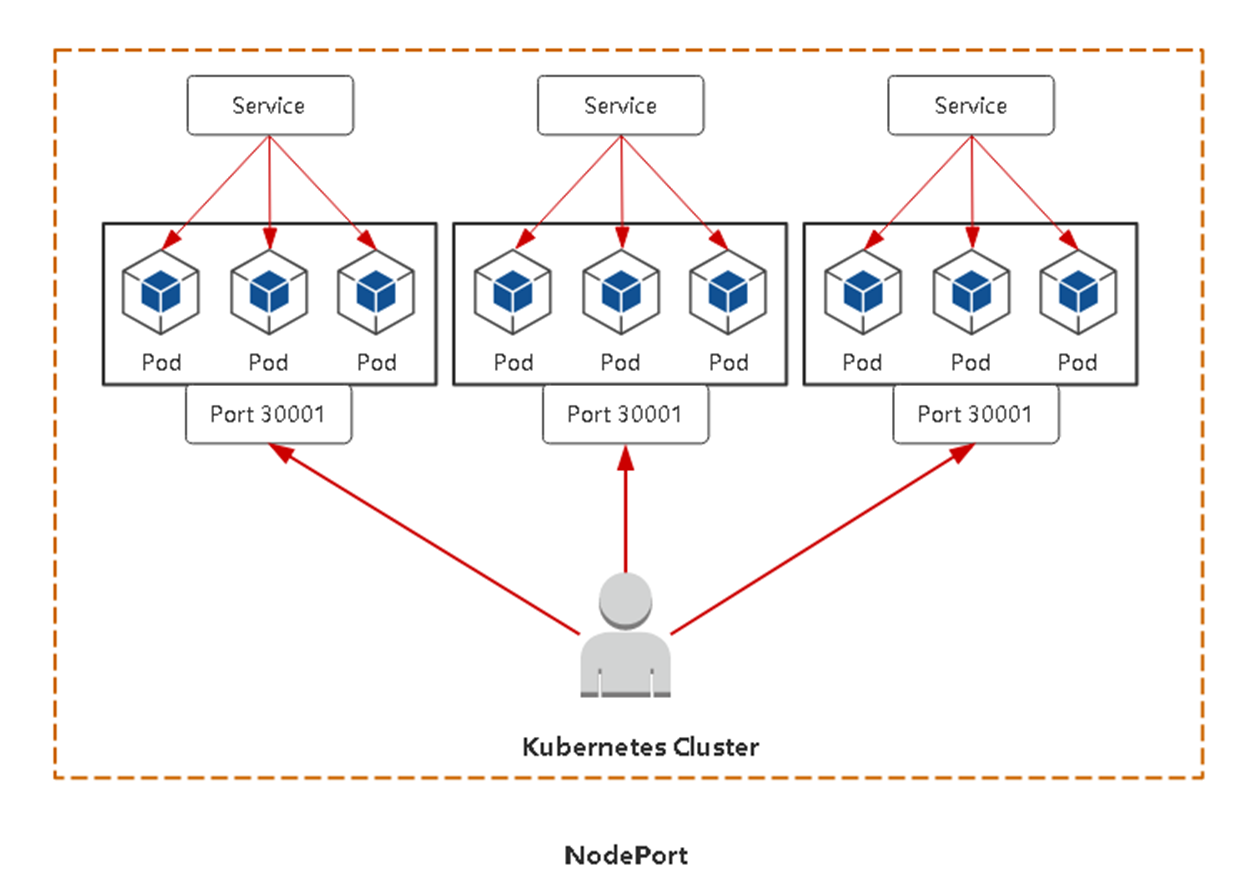

NodePort:通过每个 Node 上的 IP 和静态端口(NodePort)暴露服务。NodePort服务会路由到ClusterIP服务,这个ClusterIP服务会自动创建。通过请求:,可以从集群的外部访问一个NodePort服务。

LoadBalancer:使用云提供商的负载均衡器,可以向外部暴露服务。外部的负载均衡器可以路由到NodePort服务和ClusterIP服务。

ExternalName:通过返回CNAME和它的值,可以将服务映射到externalName字段的内容(例如,foo.bar.example.com)。 没有任何类型代理被创建,这只有 Kubernetes 1.7 或更高版本的kube-dns才支持。

ClusterIP

示例yaml

~]# cat redis-svc.yaml

apiVersion: v1

kind: Service

metadata:

name: redis

namespace: default

spec:

selector: #标签选择器,必须指定pod资源本身的标签

app: redis

role: logstor

type: ClusterIP #指定服务类型为ClusterIP

ports: #指定端口

- port: 6379 #暴露给服务的端口

targetPort: 6379 #容器的端口

创建并查看

~]# kubectl apply -f ds-demo.yaml

deployment.apps/redis created

~]# kubectl create -f redis-svc.yaml

service/redis created

~]# kubectl get svc

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes ClusterIP 10.0.0.1 <none> 443/TCP 12d

redis ClusterIP 10.0.0.137 <none> 6379/TCP 9s

~]# kubectl describe svc redis

Name: redis

Namespace: default

Labels: <none>

Annotations: <none>

Selector: app=redis,role=logstor

Type: ClusterIP

IP: 10.0.0.137 #service ip

Port: <unset> 6379/TCP

TargetPort: 6379/TCP

Endpoints: 10.244.2.13:6379 #此处的ip+端口就是pod的ip+端口

Session Affinity: None

Events: <none>

~]# kubectl get pod redis-646cf89449-l67dj -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

redis-646cf89449-l67dj 1/1 Running 0 2m3s 10.244.2.13 k8s-node2 <none> <none>

从上演示可以总结出:service不会直接到pod,service是直接到endpoint资源,就是地址加端口,再由endpoint再关联到pod。

service只要创建完,就会在dns中添加一个资源记录进行解析,添加完成即可进行解析。资源记录的格式为:SVC_NAME.NS_NAME.DOMAIN.LTD.

默认的集群service 的A记录:svc.cluster.local.

redis服务创建的A记录:redis.default.svc.cluster.local.

NodePort

NodePort即节点Port,通常在部署Kubernetes集群系统时会预留一个端口范围用于NodePort,其范围默认为:30000~32767之间的端口。定义NodePort类型的Service资源时,需要使用.spec.type进行明确指定。

查看已有web-pod

~]# kubectl get pods --show-labels |grep web

web-7c95ff84fc-6n4sg 1/1 Running 0 9d app=web,pod-template-hash=7c95ff84fc,release=canary

web-7c95ff84fc-cj84l 1/1 Running 0 9d app=web,pod-template-hash=7c95ff84fc,release=canary

web-7c95ff84fc-krxgz 1/1 Running 0 2m5s app=web,pod-template-hash=7c95ff84fc,release=canary

web-7c95ff84fc-sv277 1/1 Running 0 2m5s app=web,pod-template-hash=7c95ff84fc,release=canary

web-7c95ff84fc-zqqz6 1/1 Running 0 2m5s app=web,pod-template-hash=7c95ff84fc,release=canary

为web创建service

~]# cat web-svc.yaml

apiVersion: v1

kind: Service

metadata:

name: myapp

namespace: default

spec:

selector:

app: web

release: canary

type: NodePort

ports:

- port: 80

targetPort: 80

nodePort: 30080

创建并查看

~]# kubectl apply -f web-svc.yaml

service/myapp configured

~]# kubectl get svc

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes ClusterIP 10.0.0.1 <none> 443/TCP 12d

myapp NodePort 10.0.0.229 <none> 80:30080/TCP 2m25s

redis ClusterIP 10.0.0.137 <none> 6379/TCP 47m

~]# while true;do curl http://192.168.121.82:30080/hostname.html;sleep 1;done

web-7c95ff84fc-6n4sg

web-7c95ff84fc-cj84l

web-7c95ff84fc-zqqz6

web-7c95ff84fc-krxgz

web-7c95ff84fc-cj84l

web-7c95ff84fc-sv277

web-7c95ff84fc-6n4sg

web-7c95ff84fc-6n4sg

web-7c95ff84fc-cj84l

web-7c95ff84fc-zqqz6

web-7c95ff84fc-6n4sg

web-7c95ff84fc-cj84l

web-7c95ff84fc-cj84l

web-7c95ff84fc-cj84l

~]# while true;do curl http://192.168.121.82:30080/;sleep 1;done

Hello MyApp | Version: v2 | <a href="hostname.html">Pod Name</a>

Hello MyApp | Version: v2 | <a href="hostname.html">Pod Name</a>

Hello MyApp | Version: v2 | <a href="hostname.html">Pod Name</a>

Hello MyApp | Version: v2 | <a href="hostname.html">Pod Name</a>

Hello MyApp | Version: v2 | <a href="hostname.html">Pod Name</a>

Hello MyApp | Version: v2 | <a href="hostname.html">Pod Name</a>

Hello MyApp | Version: v2 | <a href="hostname.html">Pod Name</a>

从以上例子,可以看到通过NodePort方式已经实现了从集群外部端口进行访问,访问链接如下:http://192.168.121.82:30080/。实践中并不鼓励用户自定义使用节点的端口,因为容易和其他现存的Service冲突,建议留给系统自动配置。

Pod会话保持

Service资源还支持Session affinity(粘性会话)机制,可以将来自同一个客户端的请求始终转发至同一个后端的Pod对象,这意味着它会影响调度算法的流量分发功用,进而降低其负载均衡的效果。因此,当客户端访问Pod中的应用程序时,如果有基于客户端身份保存某些私有信息,并基于这些私有信息追踪用户的活动等一类的需求时,那么应该启用session affinity机制。

Service affinity的效果仅仅在一段时间内生效,默认值为10800秒,超出时长,客户端再次访问会重新调度。该机制仅能基于客户端IP地址识别客户端身份,它会将经由同一个NAT服务器进行原地址转换的所有客户端识别为同一个客户端,由此可知,其调度的效果并不理想。Service 资源 通过. spec. sessionAffinity 和. spec. sessionAffinityConfig 两个字段配置粘性会话。 spec. sessionAffinity 字段用于定义要使用的粘性会话的类型,它仅支持使用“ None” 和“ ClientIP” 两种属性值。如下:

]# kubectl explain svc.spec.sessionAffinity

KIND: Service

VERSION: v1

FIELD: sessionAffinity <string>

DESCRIPTION:

Supports "ClientIP" and "None". Used to maintain session affinity. Enable

client IP based session affinity. Must be ClientIP or None. Defaults to

None. More info:

https://kubernetes.io/docs/concepts/services-networking/service/#virtual-ips-and-service-proxies

sessionAffinity支持ClientIP和None 两种方式,默认是None(随机调度) ClientIP是来自于同一个客户端的请求调度到同一个pod中

~]# vim web-svc.yaml

apiVersion: v1

kind: Service

metadata:

name: myapp

namespace: default

spec:

selector:

app: web

release: canary

sessionAffinity: ClientIP

type: NodePort

ports:

- port: 80

targetPort: 80

nodePort: 30080

创建并查看

~]# kubectl apply -f web-svc.yaml

service/myapp configured

~]# kubectl describe svc myapp

Name: myapp

Namespace: default

Labels: <none>

Annotations: kubectl.kubernetes.io/last-applied-configuration:

{"apiVersion":"v1","kind":"Service","metadata":{"annotations":{},"name":"myapp","namespace":"default"},"spec":{"ports":[{"nodePort":30080,...

Selector: app=web,release=canary

Type: NodePort

IP: 10.0.0.229

Port: <unset> 80/TCP

TargetPort: 80/TCP

NodePort: <unset> 30080/TCP

Endpoints: 10.244.0.15:80,10.244.0.9:80,10.244.1.10:80 + 2 more...

Session Affinity: ClientIP

External Traffic Policy: Cluster

Events: <none>

~]# while true;do curl http://192.168.121.82:30080/hostname.html;sleep 1;d

one

web-7c95ff84fc-krxgz

web-7c95ff84fc-krxgz

web-7c95ff84fc-krxgz

web-7c95ff84fc-krxgz

web-7c95ff84fc-krxgz

web-7c95ff84fc-krxgz

web-7c95ff84fc-krxgz

web-7c95ff84fc-krxgz

web-7c95ff84fc-krxgz

web-7c95ff84fc-krxgz

也可以使用打补丁的方式进行修改yaml内的内容,如下:

kubectl patch svc myapp -p '{"spec":{"sessionAffinity":"ClusterIP"}}'

#session保持,同一ip访问同一个pod

kubectl patch svc myapp -p '{"spec":{"sessionAffinity":"None"}}'

#取消session

Headless Service

没有Cluster IP 的Service

有时不需要或不想要负载均衡,以及单独的 Service IP。 遇到这种情况,可以通过指定 Cluster IP(spec.clusterIP)的值为 "None" 来创建 Headless Service。

这个选项允许开发人员自由寻找他们自己的方式,从而降低与 Kubernetes 系统的耦合性。 应用仍然可以使用一种自注册的模式和适配器,对其它需要发现机制的系统能够很容易地基于这个 API 来构建。

对这类 Service 并不会分配 Cluster IP,kube-proxy 不会处理它们,而且平台也不会为它们进行负载均衡和路由。 DNS 如何实现自动配置,依赖于 Service 是否定义了 selector。

Headless Service示例

编写Headless Service资源清单,并创建

]# yum install bind-utils #dig包

]# cp web-svc.yaml web-svc-headless.yaml

]# vim web-svc-headless.yaml

apiVersion: v1

kind: Service

metadata:

name: myapp-headless

namespace: default

spec:

selector:

app: myapp

release: canary

clusterIP: "None" #headless的clusterIP值为None

ports:

- port: 80

targetPort: 80

~]# kubectl apply -f web-svc-headless.yaml

service/myapp-headless created

~]# kubectl get svc

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes ClusterIP 10.0.0.1 <none> 443/TCP 13d

myapp NodePort 10.0.0.229 <none> 80:30080/TCP 54m

myapp-headless ClusterIP None <none> 80/TCP 31s

redis ClusterIP 10.0.0.137 <none> 6379/TCP 99m

使用coredns进行解析验证

~]# kubectl get svc -n kube-system

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kube-dns ClusterIP 10.0.0.2 <none> 53/UDP,53/TCP 13d

~]# dig -t A myapp-headless.default.svc.cluster.local. @10.0.0.2

; <<>> DiG 9.11.4-P2-RedHat-9.11.4-9.P2.el7 <<>> -t A myapp-headless.default.svc.cluster.local. @10.0.0.2

;; global options: +cmd

;; Got answer:

;; WARNING: .local is reserved for Multicast DNS

;; You are currently testing what happens when an mDNS query is leaked to DNS

;; ->>HEADER<<- opcode: QUERY, status: NOERROR, id: 27257

;; flags: qr aa rd ra; QUERY: 1, ANSWER: 5, AUTHORITY: 0, ADDITIONAL: 1

;; OPT PSEUDOSECTION:

; EDNS: version: 0, flags:; udp: 4096

;; QUESTION SECTION:

;myapp-headless.default.svc.cluster.local. IN A

;; ANSWER SECTION:

myapp-headless.default.svc.cluster.local. 5 IN A 10.244.2.9

myapp-headless.default.svc.cluster.local. 5 IN A 10.244.0.15

myapp-headless.default.svc.cluster.local. 5 IN A 10.244.0.9

myapp-headless.default.svc.cluster.local. 5 IN A 10.244.1.10

myapp-headless.default.svc.cluster.local. 5 IN A 10.244.2.15

;; Query time: 0 msec

;; SERVER: 10.0.0.2#53(10.0.0.2)

;; WHEN: Sun Mar 15 11:22:45 CST 2020

;; MSG SIZE rcvd: 349

~]# kubectl get pods -o wide -l app=web

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

web-7c95ff84fc-6n4sg 1/1 Running 0 9d 10.244.0.9 k8s-node1 <none> <none>

web-7c95ff84fc-cj84l 1/1 Running 0 9d 10.244.2.9 k8s-node2 <none> <none>

web-7c95ff84fc-krxgz 1/1 Running 0 102m 10.244.0.15 k8s-node1 <none> <none>

web-7c95ff84fc-sv277 1/1 Running 0 102m 10.244.1.10 k8s-master2 <none> <none>

web-7c95ff84fc-zqqz6 1/1 Running 0 102m 10.244.2.15 k8s-node2 <none> <none>

对比含有ClusterIP的service解析

~]# dig -t A myapp.default.svc.cluster.local. @10.0.0.2

; <<>> DiG 9.11.4-P2-RedHat-9.11.4-9.P2.el7 <<>> -t A myapp.default.svc.cluster.local. @10.0.0.2

;; global options: +cmd

;; Got answer:

;; WARNING: .local is reserved for Multicast DNS

;; You are currently testing what happens when an mDNS query is leaked to DNS

;; ->>HEADER<<- opcode: QUERY, status: NOERROR, id: 61492

;; flags: qr aa rd ra; QUERY: 1, ANSWER: 1, AUTHORITY: 0, ADDITIONAL: 1

;; OPT PSEUDOSECTION:

; EDNS: version: 0, flags:; udp: 4096

;; QUESTION SECTION:

;myapp.default.svc.cluster.local. IN A

;; ANSWER SECTION:

myapp.default.svc.cluster.local. 5 IN A 10.0.0.229

;; Query time: 0 msec

;; SERVER: 10.0.0.2#53(10.0.0.2)

;; WHEN: Sun Mar 15 11:30:25 CST 2020

;; MSG SIZE rcvd: 107

~]# kubectl get svc

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes ClusterIP 10.0.0.1 <none> 443/TCP 13d

myapp NodePort 10.0.0.229 <none> 80:30080/TCP 75m

myapp-headless ClusterIP None <none> 80/TCP 20m

redis ClusterIP 10.0.0.137 <none> 6379/TCP 120m

从以上的演示可以看到对比普通的service和headless service,headless service做dns解析是直接解析到pod的而servcie是解析到ClusterIP的,那么headless有什么用呢???这将在statefulset中应用到,这里暂时仅仅做了解什么是headless service和创建方法。

NodePort:client → NodeIP:NodePorts → ClusterIP:servicePort → PodIP:containerPort

Headless Service:ServiceName → PodIP