2015年的经典分类论文整理如下

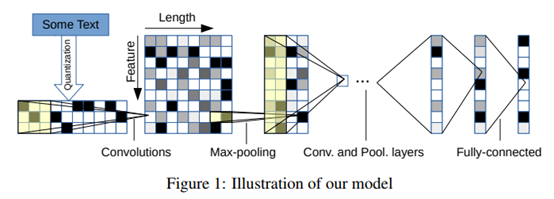

1.character-level-convolutional-networks-for-text-classification

基本信息:2015 nips 1000+

模型参数:字符个数70,亦即特征有70;输入长度是1014,每个字母可以是one-hot或者是embedding;非padding,在文本长度上做pooling;下图仅仅是指示conv和pool的计算方式,维度上并没有与原论文对应。

优势:不需要已有的语法或者语义信息;能够处理很多语言,因为它所有语言都是通过character组成的;也能检测到拼写错误和表情符号。

2.Recurrent Convolutional Neural Networks for Text Classification

基本信息:2015 AAAI 500+

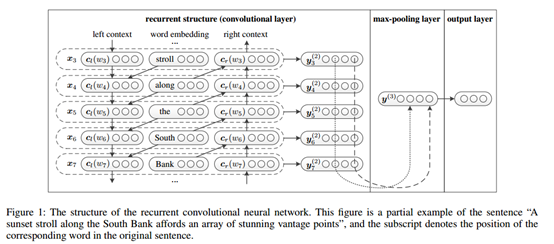

提出问题:传统特征表达忽略了上下文信息和词序;high-order n-gram 会出现数据稀疏问题;recursive NN可以表达文本,但是时间复杂度是O(n2);RNN是一个有偏向性的模型,后来的词比较重要。

解决问题:RNN捕捉上下文信息,而max-pooling选取最重要的信息给分类。

共性知识:CNN可以很好地检测到语义信息

先通过双向RNN处理,而后再通过乘以权重、最后pooling