一、卷积网络基本概念

作用:

也可以称作为滤波器,是消除噪声(在图像上是指引起较强视觉效果的孤立像素点或像素块),提取主要研究对象。

优点:

参数共享

利用BP自动学习权重特征

缺点:

需要大量的有监督数据

特征:

较浅的卷积层感受野较小,学习到一些局部区域的特征。较深的卷积层具有较大的感受野,能够学习到更加抽象一些的特征(图像更加精华的内容)。

具有平移不变性( translation invariance)

图像的大小不影响卷积。

经过多次卷积(包括pooling)以后,得到的图像越来越小,分辨率越来越低(粗略的图像)

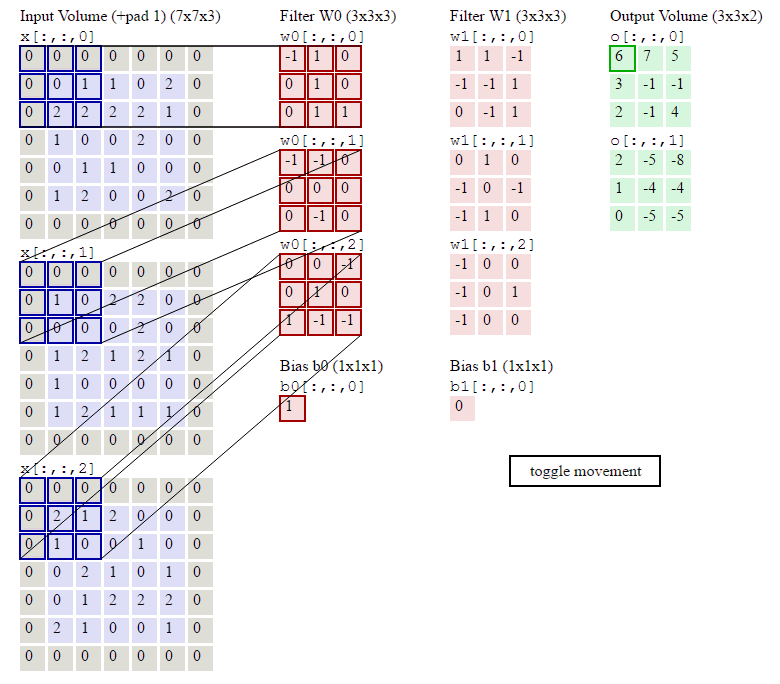

具体执行方式:

对应的位置相乘,然后相加即可,这个过程就是卷积

二、按照卷积核的功用

其中可分为两种类型,一种是参数值可学习,另一种是参数值不可学习。

1.可学习的卷积核

1)普通卷积核,随机初始化,具体参数值可通过bp学习

2)高斯卷积核,通过bp学习均值和方差

对整幅图像进行加权平均操作的过程。适用于使图片产生模糊(可以理解成每一个像素都取周边像素的平均值)的效果。

卷积核的权重总值等于1。否则的话,使用总值大于1的滤镜会让图像偏亮,小于1的滤镜会让图像偏暗。

2.不可学习的卷积核

1)均值核,去除椒盐噪声(所谓椒盐,椒就是黑,盐就是白,椒盐噪声就是在图像上随机出现黑色白色的像素)。

2)空卷积核,只有中心为1,其它都为0,相对于什么也没有做。

三、按照卷积核的卷积方式

1.反卷积(Deconvolution)

虽然下采样(downsample),就是pooling不可逆,但是借用反卷积可以做一定程度的还原。

反卷积就是上采样(upsample),其中包括有转置卷积、空洞卷积(Dilated convolution)

1)空洞卷积

作用:通过空洞卷积可以在保持卷积核参数大小不变的同时,增大卷积的视野。

借用论文中的图

(a)是普通的卷积,对应的卷积核是3x3,1-dilated convolution

(b)对应的是3x3的卷积核,2-dilated convolution;相对于7x7的卷积核,1-dilated convolution对应的感受野

(c)对应的是3x3的卷积核,4-dilated convolution;相对于15x15的卷积核,1-dilated convolution对应的感受野

对于空洞部分补0或者是双线性插值。

原论文:https://arxiv.org/pdf/1511.07122v2.pdf

2)转置卷积

转置卷积只能还原shape大小,而不能还原value。

具体操作如下:

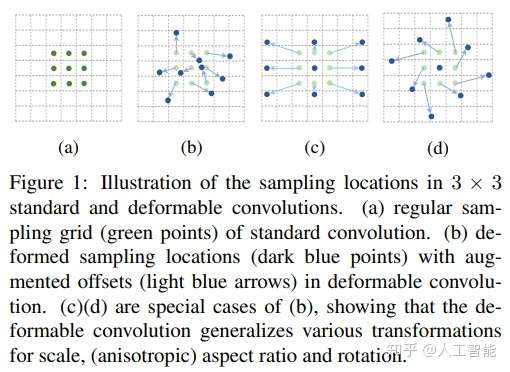

2.可变性卷积(Deformable Convolutional Network)

卷积核中的每个值均对应一个偏置,达到了卷积不是固定方格的效果,参数量是普通的卷积核的两倍(多出来的部分是记录偏置)。

代码参考: https://github.com/msracver/Deformable-ConvNets

按照功用分类可参考博客:https://www.jianshu.com/p/8d2d93c42